Das Wichtigste in Kürze

Weniger als 1 von 10.

So wenige KI-generierte Antworten enthalten einen Brand-Link (Search Engine Journal). Dein Content kann bei Google auf Seite 1 ranken — und trotzdem in ChatGPT, Perplexity und Google AI Overviews komplett fehlen. Weil die Regeln andere sind.

Ein GEO-Audit (Generative Engine Optimization Audit) beantwortet eine einzige Frage: Können KI-Suchmaschinen deinen Content finden, verstehen und zitieren? Nicht „rankst du?“ — sondern „wirst du empfohlen?“

Der Unterschied zum klassischen SEO-Audit:

| Dimension | SEO-Audit | GEO-Audit |

|---|---|---|

| Ziel | Google-Rankings verbessern | KI-Zitierungen erhalten |

| Erfolgsmessung | Position, CTR, Traffic | Citation Rate, Share of Voice, Brand Mentions |

| Content-Fokus | Keyword-Optimierung | Extrahierbarkeit, Answer Capsules |

| Technisch | Googlebot crawlen lassen | GPTBot, ClaudeBot, PerplexityBot crawlen lassen |

| Off-Page | Backlink-Profil | Web Mentions (3× stärker als Backlinks) |

| Konkurrenz | 10 Plätze auf Seite 1 | 2-3 Quellen pro KI-Antwort |

Braucht man beides? Ja. SEO bildet das Fundament. GEO fügt die KI-spezifischen Signale hinzu. Die Unterschiede haben wir in unserem GEO vs. SEO Vergleich detailliert erklärt. Dieser Artikel gibt dir die komplette GEO-Audit-Checkliste — 7 Phasen, 50 Prüfpunkte, Scoring-System.

Die Grundlagen findest du in unserem vollständigen GEO-Guide.

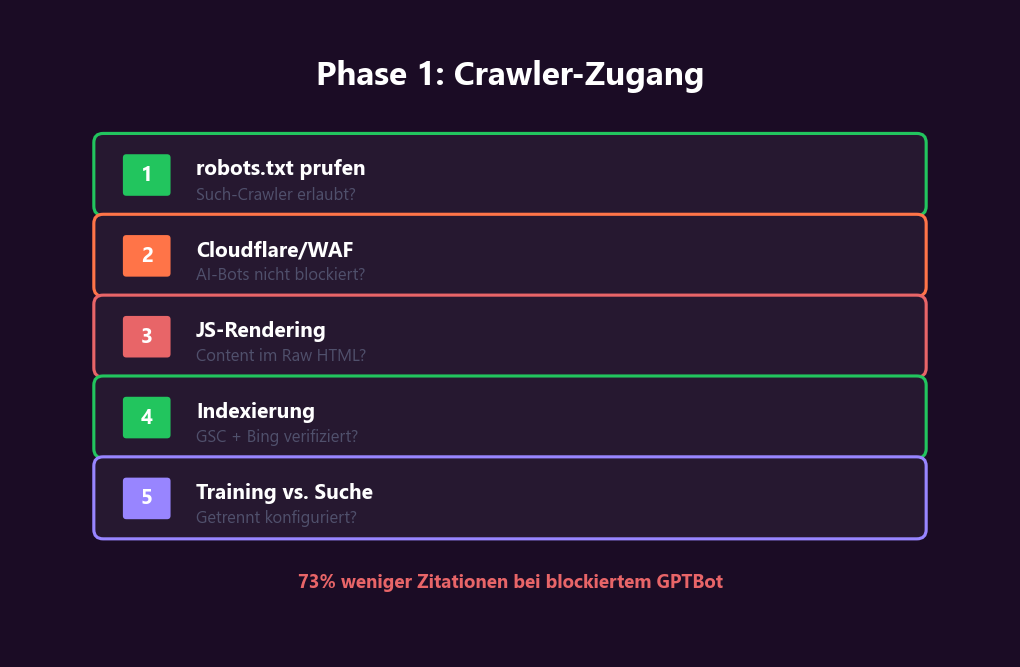

73 % weniger Zitationen.

Websites, die GPTBot blockieren, werden 73 % seltener in ChatGPT-Antworten zitiert (LLMRefs). Und der häufigste GEO-Audit-Fehler ist genau das: blockierte KI-Crawler — oft durch eine breite Disallow-Regel nach einer Website-Migration oder durch Cloudflare, das seit Kurzem AI-Bots per Default blockiert.

1. robots.txt prüfen: Öffne deine-domain.de/robots.txt im Browser. Sind GPTBot, ClaudeBot, PerplexityBot explizit mit Allow: / oder gar nicht erwähnt? Wenn Disallow: / für diese Bots steht, blockierst du aktiv deine KI-Sichtbarkeit.

2. Training vs. Suche trennen: Blockiere Training-Crawler (GPTBot, ClaudeBot, Google-Extended), aber erlaube Such-Crawler (OAI-SearchBot, Claude-SearchBot, PerplexityBot). Die vollständige Konfiguration findest du in unserem robots.txt Guide für KI-Crawler.

3. Cloudflare/WAF prüfen: Wenn du Cloudflare nutzt, prüfe unter Security → Bots ob „AI Bots“ blockiert werden. Cloudflare hat die Default-Konfiguration geändert — viele Websites blockieren KI-Bots unwissentlich.

4. JavaScript-Rendering testen: Rechtsklick → „Quelltext anzeigen“ (nicht Inspect Element!). Was hier NICHT steht, sehen KI-Bots nicht. Bei SPAs mit Client-Side Rendering sind 50-80 % des Contents unsichtbar für KI-Crawler. Lösung: Server-Side Rendering.

5. Indexierung verifizieren: Google Search Console → Seiten → Indexiert. Bing Webmaster Tools → Indexstatus. Ohne Indexierung bei Google und Bing keine KI-Sichtbarkeit — weder in AI Overviews noch in ChatGPT (nutzt Bing-Index).

Halbherziges Schema schadet.

Growth Marshal hat es gemessen: Generisches Schema (nur Article + Organization) erreicht eine Zitationsrate von 41,6 %. Seiten OHNE Schema: 59,8 %. Attribut-reiches Schema: 61,7 %. Das heißt: Halbherziges Schema ist schlimmer als gar keines. Entweder vollständig ausfüllen oder weglassen.

1. Organization Schema: Homepage mit Name, URL, Logo, Gründungsdatum, Social Profiles. sameAs-Links zu LinkedIn, Wikipedia, Wikidata — weniger als 4 % der Websites nutzen sameAs, obwohl es einer der stärksten Entity-Signale ist.

2. Article/BlogPosting Schema: Auf jeder Content-Seite: headline, author (verlinkt mit Person Schema), datePublished, dateModified, publisher.

3. FAQPage Schema: Auf jeder Seite mit FAQ-Sektion. Erhöht Citations um ~11 % (SE Ranking). Fragen als eigenständige Q&A-Paare, nicht als Fließtext.

4. Service/Product Schema: Auf Leistungs- und Produktseiten mit allen relevanten Attributen — nicht nur Typ und Name, sondern Preis, Verfügbarkeit, Bewertungen, Beschreibung.

5. Validierung: Google Rich Results Test + Schema.org Validator laufen lassen. Null Errors. Warnings lösen wo möglich. In der Search Console unter „Verbesserungen“ prüfen.

Die vollständige Schema-Anleitung mit JSON-LD-Beispielen findest du in unserem Schema Markup für GEO Guide.

2,8× höhere Zitationswahrscheinlichkeit.

So viel bringt eine sequenzielle Heading-Hierarchie (H1→H2→H3) gegenüber unstrukturiertem Content (AirOps, 548.534 Seiten). KI-Suchmaschinen extrahieren keine ganzen Artikel — sie extrahieren Passagen. Und strukturierter Content liefert bessere Passagen.

1. Answer-First-Struktur: Beginnt jede Sektion mit einer direkten Antwort in 40-60 Wörtern? 44 % aller KI-Zitationen kommen aus den ersten 30 % des Contents. Wer die Antwort erst im dritten Absatz liefert, verliert.

2. Heading-Hierarchie: H1→H2→H3 ohne Sprünge? 68,7 % der KI-zitierten Seiten folgen dieser Struktur, nur 23,9 % der Google-Ergebnisse.

3. Frage-basierte Überschriften: Mindestens 30 % der H2s als Fragen formuliert? „Was kostet eine GEO-Optimierung?“ statt „Kosten“.

4. Listen und Tabellen: Mindestens 4 Listenblöcke pro Artikel? Tabellen erhöhen die Zitationsrate um 35 % (Merchynt). KI-zitierte Seiten haben 17× höhere Listen-Dichte als Google-Ergebnisse.

5. Sektionslänge: 100-180 Wörter pro Sektion? Sektionen unter 50 Wörtern haben 70 % weniger Zitationen (SE Ranking). Zu kurz = zu wenig Kontext.

6. Eigenständigkeit: „Information Island Test“ — ist jede Sektion ALLEIN verständlich, wenn sie aus dem Artikel extrahiert wird? Keine Verweise auf „wie oben erwähnt“.

7. Statistiken mit Quellen: Alle 150-200 Wörter ein spezifischer Datenpunkt MIT Quellenangabe? Die Princeton-Studie zeigt: +32,8 % Sichtbarkeit durch Statistiken.

8. Experten-Zitate: 2-3 direkte Zitate pro Artikel? +42,6 % Sichtbarkeit laut Princeton — die stärkste Einzelmethode.

9. FAQ-Sektion: 5-8 echte Nutzerfragen mit eigenständigen Antworten? FAQ-Sektionen liefern ~11 % mehr Citations.

10. Content-Frische: Wichtige Seiten in den letzten 3 Monaten aktualisiert? Content älter als 3 Monate verliert massiv an KI-Zitationen. „Last Updated“ sichtbar anzeigen.

Die konkreten Content-Methoden haben wir in unserem Guide zu zitierfähigem Content datenbasiert aufgeschlüsselt.

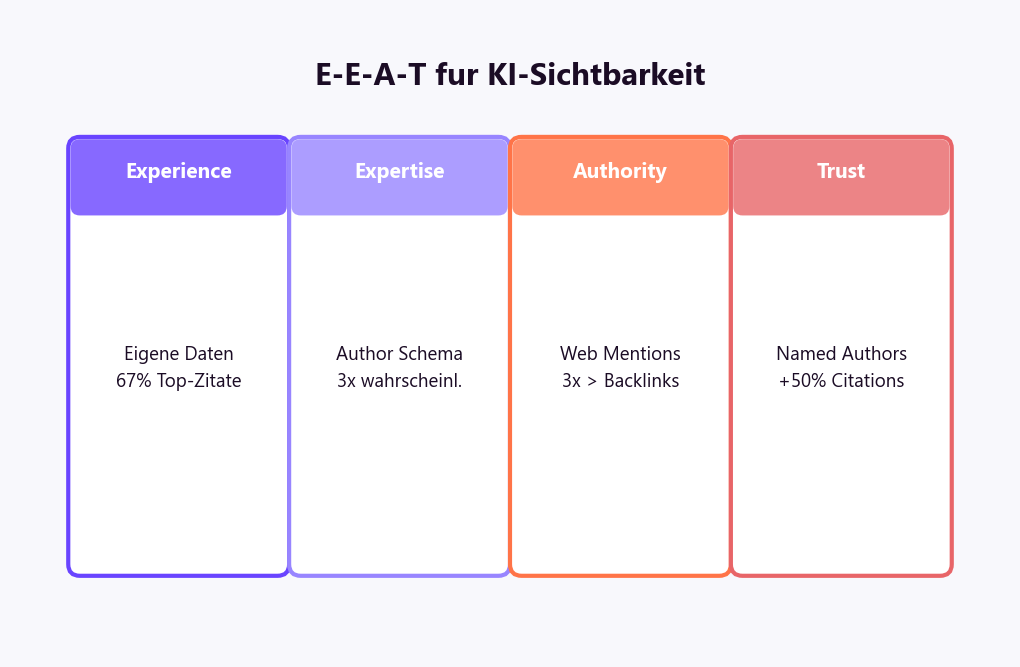

Named Authors erhöhen Citations um 50 %.

Das ist keine Vermutung — Merchynt hat es gemessen. Und BrightEdge zeigt: Seiten mit Author Schema sind 3× wahrscheinlicher in KI-Antworten. E-E-A-T ist nicht nur ein Google-Konzept — KI-Suchmaschinen bewerten dieselben Signale.

1. Autoren-Profile: Hat jede Content-Seite einen Named Author mit Bio, Qualifikationen und sameAs-Links? Person Schema implementiert?

2. Organization Schema mit sameAs: Ist dein Unternehmen mit LinkedIn, Branchenverzeichnissen, Wikipedia (falls vorhanden) verknüpft?

3. Über-uns-Seite: Vollständig mit Team, Credentials, Geschichte, Kontaktdaten? KI-Systeme prüfen die About-Page als Trust-Signal.

4. Eigene Daten und Erfahrung: Enthält dein Content Original-Research, proprietäre Benchmarks, echte Case Studies? 67 % der Top-ChatGPT-Zitationen stammen aus Original-Forschung.

5. Third-Party-Präsenz: Wirst du auf Review-Portalen (G2, Trustpilot, Google Business), in Vergleichsartikeln, auf Branchen-Seiten erwähnt? Web Mentions korrelieren 3× stärker mit KI-Zitationen als Backlinks (Ahrefs).

Jede Plattform zitiert anders.

Grok hat eine Citation Rate von 27,01 %. Perplexity 13,05 %. ChatGPT nur 0,59 % — aber ChatGPT generiert 87,4 % des gesamten KI-Referral-Traffics (Superlines, Conductor). Die Plattform mit den meisten Zitationen ist nicht automatisch die wichtigste.

1. Prompt-Bibliothek erstellen: 10-20 Kern-Prompts die deine Zielgruppe stellt. „Welche Agentur für [deine Leistung]?“, „Wie funktioniert [dein Thema]?“, „[Produkt/Service] Vergleich“.

2. Systematisch testen: Jeden Prompt in ChatGPT, Perplexity, Google AI Overviews (und optional Gemini, Claude) eingeben. Dokumentieren: Wirst du erwähnt? Verlinkt? Welches Sentiment? Welche Wettbewerber erscheinen?

3. Mindestens 2× testen: KI-Antworten sind nicht konsistent — 70 % der AI Overview Inhalte ändern sich bei gleicher Query. Teste jeden Prompt an verschiedenen Tagen.

4. GA4 AI-Traffic tracken: Referral-Traffic filtern nach chatgpt.com, perplexity.ai, gemini.google.com. Custom Channel Group „AI Traffic“ erstellen.

5. Tools nutzen: Für systematisches Tracking: OtterlyAI ($29/Mo), SE Ranking ($189/Mo), oder kostenlos: HubSpot AEO Grader, Semrush AI Search Visibility Checker.

| Tool | Preis | Plattformen | Besonderheit |

|---|---|---|---|

| HubSpot AEO Grader | Kostenlos | GPT-4o, Perplexity, Gemini | 5 Dimensionen, Sofort-Ergebnis |

| Semrush AI Checker | Kostenlos | ChatGPT, Google AI, Perplexity | AI Visibility Score |

| OtterlyAI | $29/Mo | ChatGPT, Google AI, Gemini | 25+ GEO-Audit-Faktoren |

| SE Visible | $189/Mo | AI Mode, AIOs, Gemini, ChatGPT, Perplexity | Sentiment + Competitive Benchmarking |

Die plattformspezifischen Optimierungen haben wir detailliert behandelt: ChatGPT, Perplexity, Google AI Overviews.

Top-10-Marken fangen 47 % ab.

Die Top-10-Marken in jeder Branche erhalten 47 % aller KI-Zitationen. Mid-Market (Platz 11-100): 41 %. Long-Tail: nur 12 % (Superlines, Q1 2026). Wenn du nicht in den Top-10 bist, kämpfst du um Krümel.

Du willst wissen, wo du in der KI-Suche stehst — und was deine Konkurrenz besser macht?

In unserer kostenlosen GEO-Analyse prüfen wir alle 7 Phasen für dich: Crawler-Zugang, Schema, Content, E-E-A-T, Plattform-Sichtbarkeit, Wettbewerb und Metriken.

→ Jetzt kostenlose GEO-Analyse anfordern

1. Wettbewerber in KI-Antworten identifizieren: Wer erscheint, wenn deine Zielgruppe nach deiner Leistung fragt? Liste die Top-5-Wettbewerber pro Plattform.

2. Citation Share of Voice messen: Bei 20 Kern-Prompts — wie oft erscheint deine Marke vs. Wettbewerber? Ziel: 30 %+ für Kern-Queries.

3. Content-Lücken identifizieren: Welche Themen decken Wettbewerber ab, die du nicht hast? Welche FAQ-Fragen beantworten sie, die du nicht beantwortest?

4. Third-Party-Präsenz vergleichen: Auf welchen Vergleichsportalen, Review-Seiten, Branchenlisten erscheinen Wettbewerber — und du nicht?

5. Schwächen der Wettbewerber finden: Wo sind deren Inhalte veraltet, unvollständig oder ohne Quellenangaben? Das sind deine Chancen.

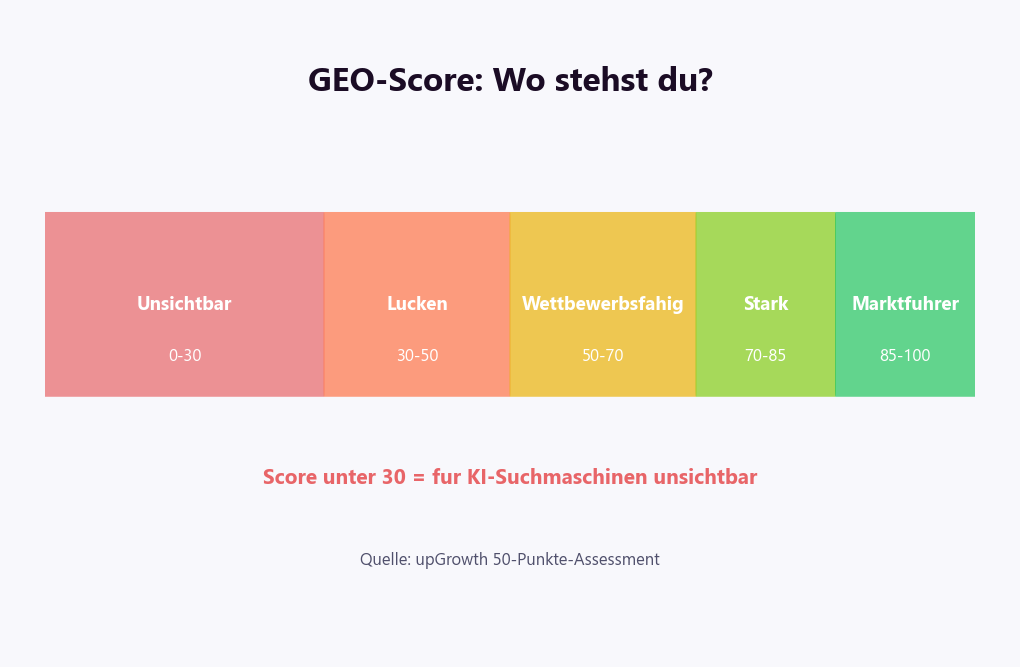

Score unter 30 = unsichtbar.

Das upGrowth-Framework definiert einen 50-Punkte-Assessment mit klarem Scoring von 0-100. Hier ist eine vereinfachte Version, die du sofort anwenden kannst:

| Phase | Max. Punkte | Prüfpunkte |

|---|---|---|

| 1. Crawler-Zugang | 15 | 5 Checks × 3 Punkte (Pass=3, Partial=1, Fail=0) |

| 2. Schema Markup | 15 | 5 Checks × 3 Punkte |

| 3. Content-Struktur | 30 | 10 Checks × 3 Punkte |

| 4. E-E-A-T & Authority | 15 | 5 Checks × 3 Punkte |

| 5. Plattform-Sichtbarkeit | 15 | 5 Checks × 3 Punkte |

| 6. Wettbewerbs-Analyse | 10 | 5 Checks × 2 Punkte |

| Gesamt | 100 | 35 Kern-Checks |

| Score | Status | Nächster Schritt |

|---|---|---|

| 0-30 | Unsichtbar | Sofort: Crawler-Zugang + Schema fixen |

| 31-50 | Fundamentale Lücken | Content-Struktur und E-E-A-T aufbauen |

| 51-70 | Wettbewerbsfähig | Plattform-spezifisch optimieren |

| 71-85 | Starke Position | Wettbewerbs-Lücken schließen |

| 86-100 | Marktführer | Monitoring + Iteration |

Deutsche Inhalte haben 45 % weniger Wettbewerb und 18 % höhere Zitationsraten als englische. Wer jetzt als deutschsprachiges Unternehmen optimiert, hat einen strukturellen Vorteil — weil die meisten DACH-Wettbewerber noch nicht GEO-optimiert sind.

Nicht alles auf einmal.

Ob SEO in der KI-Ära noch relevant ist, haben wir in Ist SEO tot? analysiert. Und die Princeton-Studie zu den effektivsten Content-Methoden findest du in unserem Princeton-GEO-Artikel.

Die vollständige GEO-Strategie — alle Bausteine zusammen — findest du in unserem kompletten GEO-Guide. Und wenn du das Audit nicht allein machen willst: Mehr zu unserer GEO-Agentur.

Ein GEO-Audit (Generative Engine Optimization Audit) prüft systematisch, ob KI-Suchmaschinen wie ChatGPT, Perplexity und Google AI Overviews deinen Content finden, verstehen und zitieren können. Es umfasst 7 Phasen: Crawler-Zugang, Schema Markup, Content-Struktur, E-E-A-T-Signale, Plattform-Sichtbarkeit, Wettbewerbs-Analyse und Messung — mit insgesamt 35-50 Prüfpunkten.

Ein SEO-Audit fragt „Kann Google mich crawlen und ranken?“ — ein GEO-Audit fragt „Zitieren KI-Suchmaschinen meinen Content?“ SEO fokussiert auf Rankings und CTR, GEO auf Citation Rate und Brand Mentions. SEO misst Backlinks, GEO misst Web Mentions (3× stärker als Backlinks für KI-Sichtbarkeit). Beides wird gebraucht — SEO ist das Fundament, GEO die Erweiterung.

Technische Checks (robots.txt, Schema) monatlich. Content-Checks (Struktur, Frische) quartalsweise. Volles GEO-Audit quartalsweise oder bei größeren Änderungen. Sofort-Audit nach Website-Relaunch, CMS-Migration oder Cloudflare-Konfigurationsänderungen — weil diese oft KI-Crawler unbeabsichtigt blockieren.

Die Top 3: (1) Blockierte KI-Crawler — oft durch breite robots.txt-Regeln oder Cloudflare Default-Settings. 73 % weniger Zitationen. (2) Generisches Schema — halbherziges Schema (41,6 % Zitationsrate) ist schlechter als kein Schema (59,8 %). (3) JavaScript-Content der unsichtbar ist — bei SPAs sind 50-80 % des Contents für KI-Bots nicht sichtbar.

Kostenlos starten: HubSpot AEO Grader (Brand-Präsenz in GPT-4o, Perplexity, Gemini), Semrush AI Search Visibility Checker, Google Rich Results Test (Schema-Validierung). Für systematisches Monitoring: OtterlyAI ab $29/Mo oder SE Ranking ab $189/Mo. Plus: Google Search Console, Bing Webmaster Tools und GA4 für Traffic-Attribution.

Vereinfachtes Scoring: 7 Phasen mit je 5-10 Prüfpunkten, bewertet mit Pass (3 Punkte), Partial (1) oder Fail (0). Maximal 100 Punkte. 0-30 = unsichtbar für KI, 31-50 = fundamentale Lücken, 51-70 = wettbewerbsfähig, 71-85 = starke Position, 86-100 = Marktführer. Das upGrowth-Framework definiert 50 detaillierte Prüfpunkte.

Die technischen Checks (robots.txt, Schema, JavaScript) und Content-Checks (Struktur, FAQ) kannst du mit diesem Artikel selbst durchführen. Für Plattform-Sichtbarkeit und Wettbewerbs-Analyse brauchst du Tools oder manuelle Tests. Am aufwendigsten: Content-Optimierung und Authority-Aufbau — das braucht strategische Planung und ist oft der größte Hebel für eine spezialisierte GEO-Agentur.

Aktuell nicht. OtterlyAI hat eine 90-Tage-Studie durchgeführt: Von 62.100+ AI-Bot-Besuchen landeten nur 84 auf /llms.txt (0,1 %). Kein statistischer Zusammenhang mit KI-Zitierungen. Eine Studie über 300.000 Domains bestätigt: Keine Korrelation. Investiere deine Zeit lieber in Schema Markup, Content-Struktur und robots.txt-Konfiguration.

DIY mit kostenlosen Tools: 0 € (aber Zeit-intensiv). Automatisierte Tools: $29-189/Mo. Professionelles Agentur-Audit: ab 2.000-5.000 € einmalig inklusive Handlungsempfehlungen. Laufende GEO-Optimierung: ab 2.000 €/Mo. Der ROI: Studien zeigen, dass mittlere GEO-Investitionen den 6,8-fachen Return bringen — das beste ROI-Verhältnis aller Investment-Stufen.

Ja — deutsche Inhalte haben 45 % weniger Wettbewerb und 18 % höhere Zitationsraten als englische (Superlines). Die meisten DACH-Unternehmen haben noch kein GEO gemacht. Wer jetzt optimiert, hat einen strukturellen Vorteil gegenüber Wettbewerbern, die nur klassisches SEO machen.

Priorität 1 (Tag 1-3): Crawler-Zugang sicherstellen — robots.txt prüfen, Cloudflare AI-Blocking deaktivieren, Schema-Fehler fixen. Priorität 2 (Woche 1-4): Content-Struktur auf Answer-First umstellen, FAQ-Sektionen ergänzen, veraltete Inhalte aktualisieren. Priorität 3 (Monat 1-3): E-E-A-T aufbauen, Third-Party-Präsenz stärken, Monitoring einrichten.